Editado por: Dr. Josep Vidal Alaball General Generalitat de Catalunya Spain

Más datosLa historia médica destaca la importancia de la ética en cada avance, y la bioética es fundamental para abordar los desafíos éticos emergentes en la salud digital (SD). Este artículo analiza los dilemas éticos de las innovaciones en SD, centrándose en el sistema de salud, los profesionales y los pacientes. La inteligencia artificial (IA) genera preocupaciones, como la confidencialidad y los sesgos algorítmicos. Las aplicaciones (App) móviles empoderan, pero generan desafíos de acceso y alfabetización digital. La telemedicina (TM) democratiza y reduce costes de la salud, pero requiere abordar la brecha digital, los dilemas en la interconsulta: requiere altos estándares de calidad, con protección de la información del paciente y atención a la equidad en el acceso. Los wearables y el internet de las cosas (IoT) transforman la atención médica, pero enfrentan desafíos éticos como la privacidad y la equidad. La bioética del sigloxxi debe ser plástica, puesto que las herramientas de SD demandan adaptabilidad, con revisión constante y consenso, exigiendo a las facultades de ciencias de la salud una preparación que se ajuste a los cambios que iremos viendo en los años venideros.

The medical history underscores the significance of ethics in each advancement, with bioethics playing a pivotal role in addressing emerging ethical challenges in digital health (DH). This article examines the ethical dilemmas of innovations in DH, focusing on the healthcare system, professionals, and patients. Artificial Intelligence (AI) raises concerns such as confidentiality and algorithmic biases. Mobile applications (Apps) empower but pose challenges of access and digital literacy. Telemedicine (TM) democratizes and reduces healthcare costs but requires addressing the digital divide and interconsultation dilemmas; it necessitates high-quality standards with patient information protection and attention to equity in access. Wearables and the Internet of Things (IoT) transform healthcare but face ethical challenges like privacy and equity. 21st-century bioethics must be adaptable as DH tools demand constant review and consensus, necessitating health science faculties’ preparedness for the forthcoming changes.

En un mundo donde la medicina y la tecnología convergen, la ética se convierte en nuestra brújula moral. Este artículo pretende exponer los dilemas más importantes que nos debemos plantear en el terreno de la salud digital (SD).

Desde la visión pionera de Van Rensselaer Potter, quien acuñó el término «bioética» en su obra Bioética, un puente hacia el futuro (1971), buscó equilibrar las orientaciones científicas de la medicina con los valores humanos, evolucionando hacia la «bioética global». La bioética, como disciplina, busca aplicar principios morales a cuestiones relacionadas con la vida, la salud y la enfermedad, integrando la ética biomédica y ambiental, para abordar desafíos contemporáneos1. Además, fomenta la creación de puentes entre profesionales de la salud y disciplinas como filosofía, antropología, derecho e investigadores, facilitando la toma de decisiones, ya sean complejas o cotidianas, en colaboración con la sociedad en general2.

Como en todo campo de la filosofía, existen diversas escuelas teóricas de bioética que se basan en diferentes principios y valores, lo que explica por qué personas con diferentes posturas filosóficas pueden llegar a conclusiones diversas sobre un mismo dilema ético3, incluso con la misma postura filosófica. Las escuelas teóricas no son mutuamente excluyentes y a menudo se utilizan en combinación para tomar decisiones éticas complejas.

Las escuelas que confluyen en la bioética contemporánea son4:

- •

El utilitarismo, el cual aboga por tomar decisiones éticas que maximicen el bienestar para el mayor número de personas.

- •

El universalismo, quien sostiene que las decisiones éticas deben basarse en principios universalmente aceptados.

- •

El personalismo, que centra las decisiones éticas en el bienestar de la persona como valor supremo.

- •

El principalismo, el cual propone que las decisiones éticas se basen en los principios de beneficencia, no maleficencia, autonomía y justicia.

- •

El positivismo, que sugiere que las decisiones éticas deben basarse en evidencia científica en lugar de en opiniones o creencias personales.

- •

El realismo, el cual sostiene la existencia independiente del mundo y los objetos.

La bioética y la ética clínica se han convertido en disciplinas esenciales en la formación de profesionales de la salud, cultivando habilidades como empatía, sensibilidad ética y razonamiento moral5.

Como sucede con cada avance en la historia, la humanidad se encuentra ante una nueva dimensión de la bioética, la cual se debe erigir como una disciplina fundamental para abordar desafíos actuales y futuros. En este contexto, la SD no puede quedarse rezagada.

En sus inicios, la SD requiere experiencia para evaluar los límites de su eficacia. A medida que avanza, surgirán reflexiones éticas sobre sus usos, aunque algunos límites ya se vislumbran.

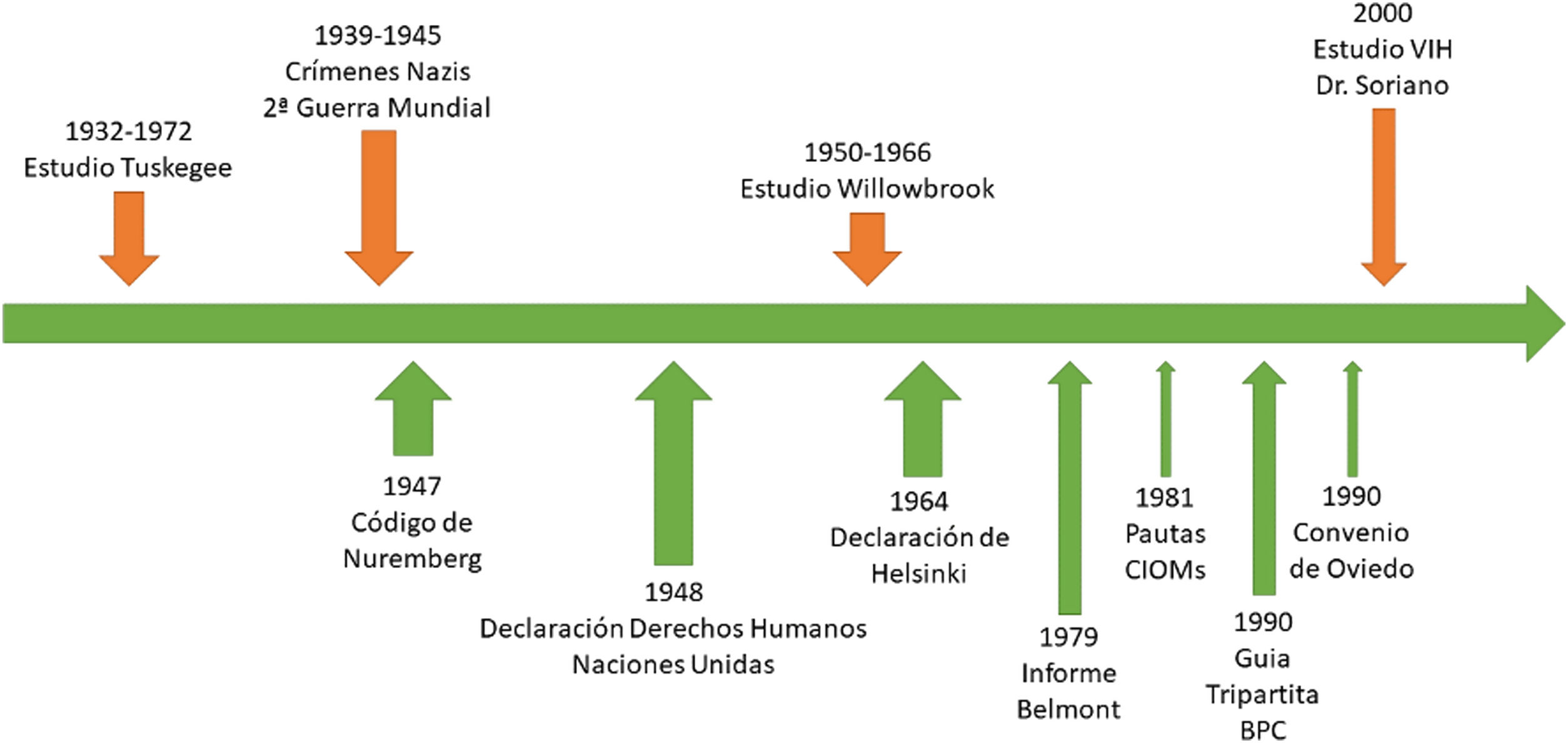

Afrontar los nuevos desafíos de la SD requiere una reflexión retrospectiva sobre la historia médica y la bioética, tal y como se puede apreciar en la figura 1. Enfocar una evolución de la bioética sin perder el norte, y con los conocimientos aprendidos de la experiencia a fin de evitar repeticiones y comprender su pertinencia, es fundamental para nuestra sociedad actual. La reflexión se hace crucial ante episodios escandalosos, como el experimento de la sífilis de Tuskegee (1932-1972), donde personas afroamericanas fueron privadas de tratamiento sin su conocimiento, durante décadas. Este episodio subrayó la necesidad de establecer estándares éticos y regulaciones en el ámbito médico. Horrores históricos como los experimentos nazis en la Segunda Guerra Mundial (1939-1945) llevaron a la promulgación del Código de Núremberg en 1947, que estableció las primeras condiciones éticas para la investigación en seres humanos, incluyendo el consentimiento, el beneficio para la sociedad y la prevención del sufrimiento, entre otros. Posteriormente, en 1948, la Declaración Universal de Derechos Humanos de las Naciones Unidas le otorgó un estatus internacional. El Estudio de Willowbrook (1950-1966), en el cual se infectó artificialmente con destilados de heces para investigar en hepatitis, en niños discapacitados, condujo a la creación de códigos éticos internacionales como la Declaración de Helsinki (1964), el Informe Belmont (1979) y el Convenio de Oviedo (1997) entre otros6.

Adaptación de figura del Máster de IA en Salud de la UAB6.

Con la creciente tecnificación de la medicina no solo han surgido, sino que seguirán surgiendo, nuevos dilemas éticos. A lo largo de la historia, la negligencia médica ha sido por desgracia el motor de la creación de códigos éticos. La previsión de los dilemas éticos propuestos por la SD nos brinda la posibilidad de abordarlos de manera proactiva y constructiva. En el siguiente análisis exploramos la influencia ética en herramientas relacionadas con la SD, desde una perspectiva que abarca el sistema de salud, los profesionales y los pacientes del sigloxxi.

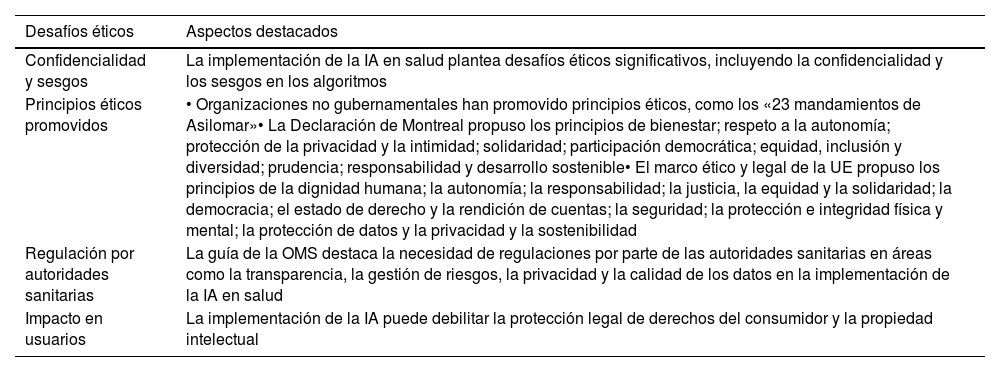

Análisis de los dilemas bioéticos en la inteligencia artificialAl igual que en anteriores revoluciones tecnológicas dentro del ámbito médico, la implementación de la inteligencia artificial (IA) en el sistema de salud presenta desafíos éticos significativos. Las directrices éticas actuales pasan por alto cuestiones fundamentales, como la confidencialidad y los sesgos en los algoritmos. Los principios éticos son esenciales para abordar dilemas relacionados con la justicia, la transparencia, la autonomía del paciente y la accesibilidad de los servicios de salud, con el fin de no acentuar las desigualdades7.

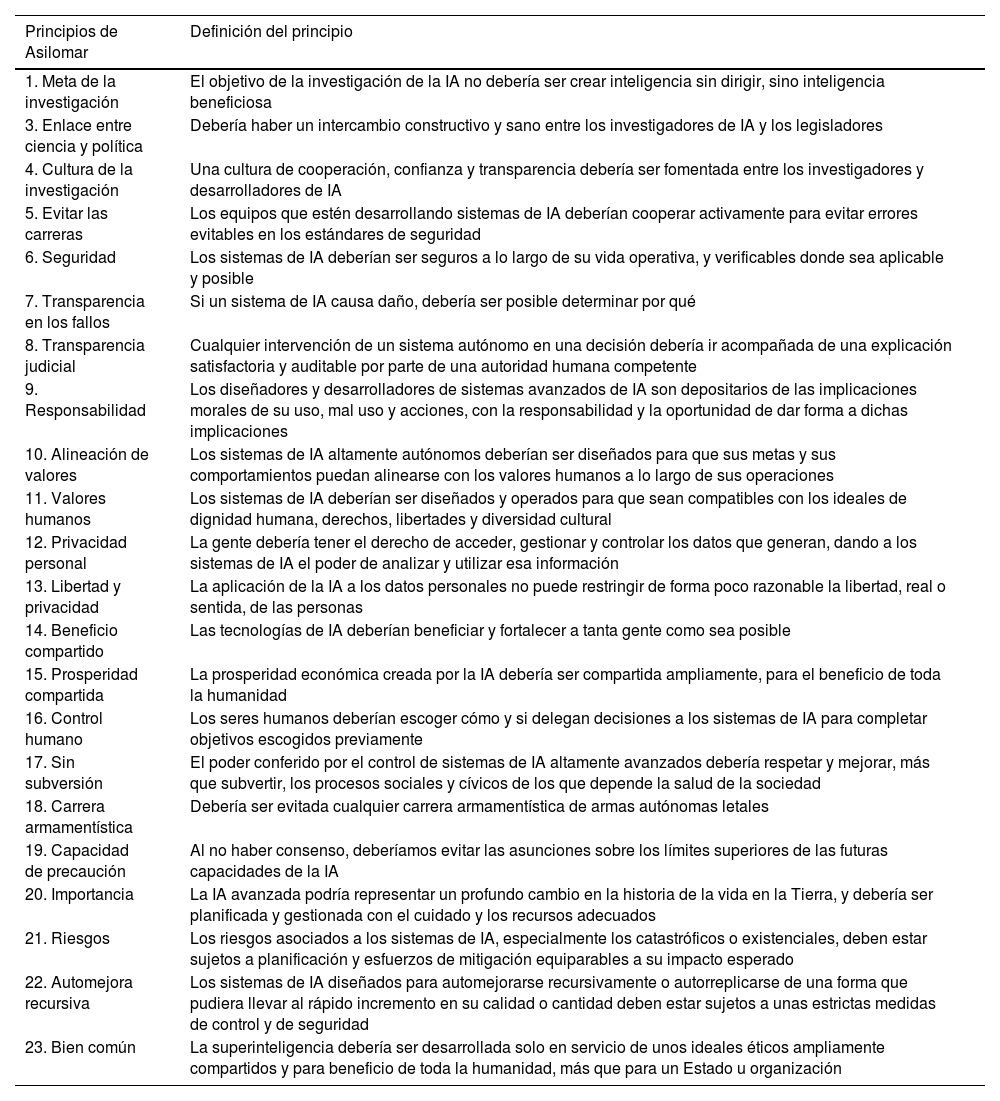

Organizaciones no gubernamentales han promovido principios éticos en este ámbito, como los «23 mandamientos de Asilomar» en 20178, detallados en la tabla 1, para abordar diversos retos y dilemas en IA. En el mismo año, la «Declaración de Montreal»9 establece diez principios para una IA ética, resumidos en la tabla 2. En 2018 la Unión Europea propuso un marco ético y legal para la IA10, cuyos nueve principios se detallan en la tabla 2. La OMS publicó una guía para la ética y la gobernanza de la IA en salud en 2021, destacando la necesidad de regulaciones por las autoridades sanitarias en áreas como la transparencia, la gestión de riesgos, la privacidad y la calidad de los datos11, con los seis principales principios:

- 1.

Promover el bienestar humano, la seguridad y el interés público.

- 2.

Proteger la autonomía humana y la privacidad de los datos.

- 3.

Solidaridad.

- 4.

Garantizar la inclusión y la equidad.

- 5.

Dignidad humana.

- 6.

Fomentar la responsabilidad y la rendición de cuentas.

Descripción de los «23 mandamientos de Asilomar». Conjunto de principios éticos propuestos por un grupo de científicos y expertos en IA y tecnología para guiar el desarrollo seguro y responsable de la IA

| Principios de Asilomar | Definición del principio |

|---|---|

| 1. Meta de la investigación | El objetivo de la investigación de la IA no debería ser crear inteligencia sin dirigir, sino inteligencia beneficiosa |

| 3. Enlace entre ciencia y política | Debería haber un intercambio constructivo y sano entre los investigadores de IA y los legisladores |

| 4. Cultura de la investigación | Una cultura de cooperación, confianza y transparencia debería ser fomentada entre los investigadores y desarrolladores de IA |

| 5. Evitar las carreras | Los equipos que estén desarrollando sistemas de IA deberían cooperar activamente para evitar errores evitables en los estándares de seguridad |

| 6. Seguridad | Los sistemas de IA deberían ser seguros a lo largo de su vida operativa, y verificables donde sea aplicable y posible |

| 7. Transparencia en los fallos | Si un sistema de IA causa daño, debería ser posible determinar por qué |

| 8. Transparencia judicial | Cualquier intervención de un sistema autónomo en una decisión debería ir acompañada de una explicación satisfactoria y auditable por parte de una autoridad humana competente |

| 9. Responsabilidad | Los diseñadores y desarrolladores de sistemas avanzados de IA son depositarios de las implicaciones morales de su uso, mal uso y acciones, con la responsabilidad y la oportunidad de dar forma a dichas implicaciones |

| 10. Alineación de valores | Los sistemas de IA altamente autónomos deberían ser diseñados para que sus metas y sus comportamientos puedan alinearse con los valores humanos a lo largo de sus operaciones |

| 11. Valores humanos | Los sistemas de IA deberían ser diseñados y operados para que sean compatibles con los ideales de dignidad humana, derechos, libertades y diversidad cultural |

| 12. Privacidad personal | La gente debería tener el derecho de acceder, gestionar y controlar los datos que generan, dando a los sistemas de IA el poder de analizar y utilizar esa información |

| 13. Libertad y privacidad | La aplicación de la IA a los datos personales no puede restringir de forma poco razonable la libertad, real o sentida, de las personas |

| 14. Beneficio compartido | Las tecnologías de IA deberían beneficiar y fortalecer a tanta gente como sea posible |

| 15. Prosperidad compartida | La prosperidad económica creada por la IA debería ser compartida ampliamente, para el beneficio de toda la humanidad |

| 16. Control humano | Los seres humanos deberían escoger cómo y si delegan decisiones a los sistemas de IA para completar objetivos escogidos previamente |

| 17. Sin subversión | El poder conferido por el control de sistemas de IA altamente avanzados debería respetar y mejorar, más que subvertir, los procesos sociales y cívicos de los que depende la salud de la sociedad |

| 18. Carrera armamentística | Debería ser evitada cualquier carrera armamentística de armas autónomas letales |

| 19. Capacidad de precaución | Al no haber consenso, deberíamos evitar las asunciones sobre los límites superiores de las futuras capacidades de la IA |

| 20. Importancia | La IA avanzada podría representar un profundo cambio en la historia de la vida en la Tierra, y debería ser planificada y gestionada con el cuidado y los recursos adecuados |

| 21. Riesgos | Los riesgos asociados a los sistemas de IA, especialmente los catastróficos o existenciales, deben estar sujetos a planificación y esfuerzos de mitigación equiparables a su impacto esperado |

| 22. Automejora recursiva | Los sistemas de IA diseñados para automejorarse recursivamente o autorreplicarse de una forma que pudiera llevar al rápido incremento en su calidad o cantidad deben estar sujetos a unas estrictas medidas de control y de seguridad |

| 23. Bien común | La superinteligencia debería ser desarrollada solo en servicio de unos ideales éticos ampliamente compartidos y para beneficio de toda la humanidad, más que para un Estado u organización |

Fuente: elaboración propia.

Resumen de dilemas bioéticos en la implementación de la inteligencia artificial (IA) en salud

| Desafíos éticos | Aspectos destacados |

|---|---|

| Confidencialidad y sesgos | La implementación de la IA en salud plantea desafíos éticos significativos, incluyendo la confidencialidad y los sesgos en los algoritmos |

| Principios éticos promovidos | • Organizaciones no gubernamentales han promovido principios éticos, como los «23 mandamientos de Asilomar»• La Declaración de Montreal propuso los principios de bienestar; respeto a la autonomía; protección de la privacidad y la intimidad; solidaridad; participación democrática; equidad, inclusión y diversidad; prudencia; responsabilidad y desarrollo sostenible• El marco ético y legal de la UE propuso los principios de la dignidad humana; la autonomía; la responsabilidad; la justicia, la equidad y la solidaridad; la democracia; el estado de derecho y la rendición de cuentas; la seguridad; la protección e integridad física y mental; la protección de datos y la privacidad y la sostenibilidad |

| Regulación por autoridades sanitarias | La guía de la OMS destaca la necesidad de regulaciones por parte de las autoridades sanitarias en áreas como la transparencia, la gestión de riesgos, la privacidad y la calidad de los datos en la implementación de la IA en salud |

| Impacto en usuarios | La implementación de la IA puede debilitar la protección legal de derechos del consumidor y la propiedad intelectual |

Fuente: elaboración propia.

Finalmente, es importante considerar el impacto en los usuarios, ya que la protección legal de derechos como los del consumidor y la propiedad intelectual pueden verse debilitados12.

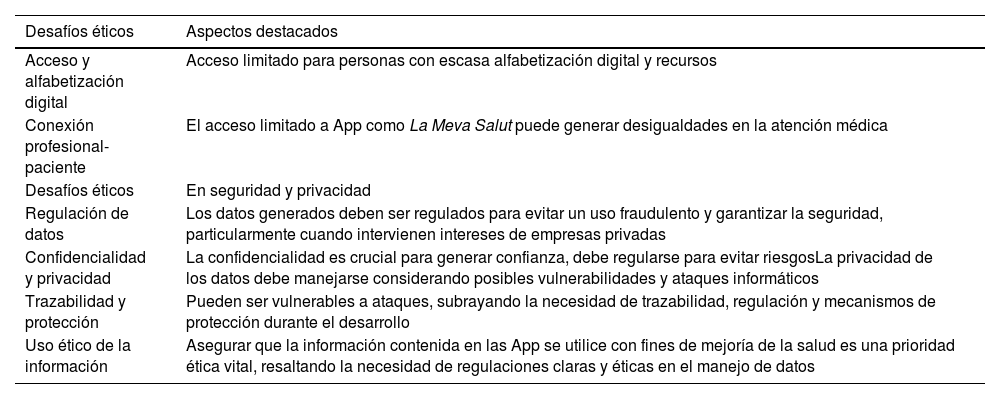

Exploración de dilemas bioéticos en las aplicaciones móviles de saludEl uso de App móviles con finalidades en salud puede suponer un reto para el sistema sanitario, en paralelo a los previamente identificados para la IA. Parece claro que, como complemento asistencial, aportan beneficios a pacientes por su empoderamiento y el mejor control de su salud13. De hecho, pueden ser un complemento para el ejercicio de la autonomía de pacientes. Herramientas como La meva salut [Mi salud]14 han establecido una conexión entre profesionales y pacientes. Sin embargo, plantea desafíos éticos, como el acceso limitado para personas que no cuentan con estas App o con escasa alfabetización digital15. A pesar de acercar la atención médica a regiones remotas, facilitando la comunicación y ofreciendo una atención inicial en lugares con limitada cobertura asistencial, impera garantizar la continuidad y la calidad asistencial.

La evaluación actual del uso de estas App en el manejo de patologías, como la salud mental, muestra un recurso prometedor, especialmente entre los más jóvenes, pero también con desafíos éticos que debemos afrontar16. No podemos olvidar que los datos generados a través de estas App deben tener una regulación segura para evitar su uso fraudulento y garantizar la seguridad, especialmente cuando intervienen intereses de empresas privadas.

Tal y como se expone en la tabla 3, la confidencialidad es un elemento crítico, pues genera confianza entre los pacientes y facilita la relación asistencial a través de las App, aunque debe ser regulada cuidadosamente para evitar riesgos.

Dilemas bioéticos en aplicaciones móviles de salud

| Desafíos éticos | Aspectos destacados |

|---|---|

| Acceso y alfabetización digital | Acceso limitado para personas con escasa alfabetización digital y recursos |

| Conexión profesional-paciente | El acceso limitado a App como La Meva Salut puede generar desigualdades en la atención médica |

| Desafíos éticos | En seguridad y privacidad |

| Regulación de datos | Los datos generados deben ser regulados para evitar un uso fraudulento y garantizar la seguridad, particularmente cuando intervienen intereses de empresas privadas |

| Confidencialidad y privacidad | La confidencialidad es crucial para generar confianza, debe regularse para evitar riesgosLa privacidad de los datos debe manejarse considerando posibles vulnerabilidades y ataques informáticos |

| Trazabilidad y protección | Pueden ser vulnerables a ataques, subrayando la necesidad de trazabilidad, regulación y mecanismos de protección durante el desarrollo |

| Uso ético de la información | Asegurar que la información contenida en las App se utilice con fines de mejoría de la salud es una prioridad ética vital, resaltando la necesidad de regulaciones claras y éticas en el manejo de datos |

Fuente: elaboración propia.

La privacidad de los datos y su gestión también deben tenerse en cuenta, ya que las App conectadas a los sistemas de información pueden representar puntos vulnerables a ataques informáticos, subrayando la necesidad de trazabilidad, de regulación y de mecanismos de protección durante las etapas iniciales de desarrollo. Asegurar que la información contenida en las App sea utilizada con fines de mejoría de la salud se convierte en una prioridad ética vital17.

Análisis de los dilemas bioéticos en telemedicinaLa telemedicina es definida por la Asociación Médica Mundial (AMM) como «el ejercicio de la medicina a distancia, cuyas intervenciones, diagnósticos, decisiones terapéuticas y recomendaciones de tratamientos subsiguientes están basadas en datos de los pacientes, documentos y otra información transmitida a través de sistemas de telecomunicación. La telemedicina puede llevarse a cabo entre un médico y un paciente, o entre dos o más médicos, incluyendo a otros profesionales de la salud»18.

La implementación de la telemedicina plantea diversos dilemas y cuestiones éticas en el ámbito político, de los pacientes, de los profesionales de la salud y del sistema sanitario en su conjunto.

Para muchos autores la telemedicina es considerada una fórmula para reducir costos y democratizar servicios médicos, abordando el problema de la justicia en salud desde una perspectiva bioética19. Sin embargo, enfrenta desafíos sustanciales, especialmente la brecha digital, que implica diferencias en las posibilidades tecnológicas y competencias generacionales, especialmente en personas mayores, con escasa alfabetización digital o para personas con discapacidad19, planteando riesgos de perpetuar la «ley de cuidados inversos» de Tudor Hart20.

Los médicos de familia manejan la mayoría de los motivos de consulta, pero alrededor del 5-6% de los casos requieren de la opinión de otros especialistas. La transferencia de información es esencial para la calidad y la seguridad del paciente. Aunque la interconsulta telemática permite consultas a otros especialistas sin desplazar al paciente, surge un dilema ético cuando estos especialistas rechazan las consultas, lo que plantea un problema de seguridad. Se aboga por una relación bidireccional más equitativa y respetuosa según los códigos deontológicos21.

Se ha planteado la telemedicina manteniendo altos estándares de calidad en la prestación de servicios médicos a distancia y garantizar la seguridad y la eficacia del tratamiento, de lo que surge la necesidad de establecer una conexión empática entre médico y paciente a través de plataformas digitales, incluyendo la prescripción de medicamentos y la evaluación de la seguridad del paciente22.

La telemedicina presenta ciertas dificultades en la protección de la información del paciente y su consentimiento informado genuino, que resultan esenciales durante las interacciones en línea, respaldando la toma de decisiones informada por parte de los pacientes mediante la transparencia en la información22.

Análisis de dilemas bioéticos en los wearables y la internet de las cosasDentro del panorama de los desafíos éticos asociados a la bioética en la SD destacan los dispositivos que se integran a las redes, tales como los dispositivos portátiles (wearables) y la internet de las cosas (Internet of Things [IoT]). Los wearables, conectados o no a una IoT, pueden recopilar una gran cantidad de datos sobre salud, ofreciendo un potencial significativo para la prevención, el diagnóstico y el tratamiento de enfermedades. Sin embargo, la implementación de estos dispositivos conlleva considerables desafíos éticos que deben ser abordados para asegurar que su uso sea ético, seguro y respetuoso.

Al considerar una eventual generalización del uso de wearables e IoT, especialmente en el sistema de atención médica, es fundamental preservar la integridad de todo el sistema de salud. Esto implica que los datos generados por estos dispositivos deben manejarse de forma ética, evitando acciones contrarias a los valores universales de la bioética; igualmente deben evitarse acciones que puedan perjudicar la privacidad, la discriminación por cualquier motivo o la generación de ganancias económicas sin la autorización de la persona usuaria. La cesión de datos personales debe regirse por la legislación vigente, como el Reglamento General de Protección de Datos (RGPD) en la Unión Europea23, asegurando transparencia y el consentimiento claro de la persona usuaria24.

En cuanto a la interacción con los profesionales de la salud, es esencial asegurar que el uso de estos dispositivos no menoscabe los derechos de los pacientes. Además de respetar los principios éticos universales, los profesionales deben velar por los aspectos intrínsecos que puedan surgir del uso de los dispositivos digitales. Los códigos deontológicos profesionales, como el promulgado por la Organización Médica Colegial de 2022, regulan los aspectos éticos de la práctica profesional en telemedicina (TM) e IA. Aunque no se centran explícitamente en la SD mediante dispositivos, sus directrices pueden extrapolarse a su uso25. Estos dispositivos podrían considerarse un producto sanitario más, pero no deben considerarse un reemplazo de la atención en salud de calidad, ni prescribirse sin el consentimiento de las personas usuarias y sin una evidencia sólida que respalde los beneficios de su uso. Además, los profesionales deben estar debidamente capacitados para usar e interpretar estos dispositivos, y utilizar esta información para la toma de decisiones de salud informadas y consensuadas con el paciente26.

Desde la perspectiva de la persona usuaria, resulta esencial garantizar que cuenten con información completa sobre la recopilación y el uso de sus datos, teniendo derecho de otorgar su consentimiento explícito y acceder a esta información. Comprender las perspectivas de los usuarios orienta el diseño de tecnología, equilibrando preocupaciones de privacidad con la calidad de la monitorización remota, velando por el bienestar y la seguridad de la persona27.

Hacia una nueva bioética del siglo xxiFinalmente, desde nuestra perspectiva, las herramientas de SD, aunque relativamente recientes, han planteado diversos dilemas éticos a lo largo del tiempo. A pesar de que se han abordado algunos de estos desafíos, es probable que surjan nuevos aspectos éticos a medida que estas tecnologías evolucionen. No obstante, la novedad de estas herramientas no debería ser motivo para eludir una revisión exhaustiva y la búsqueda de consensos con diversos actores. Es necesario que la bioética evolucione y se adapte a las exigencias de la era actual, sometiéndose a una constante revisión de los desafíos emergentes.

Adicionalmente, resulta primordial reconocer que la bioética no debe ser estática, sino más bien plástica, reflejando así su capacidad de adaptarse y responder de manera dinámica a las transformaciones continuas en el ámbito de la SD. En este sentido, las facultades de ciencias de la salud deben estar preparadas para ajustar sus enfoques educativos y prácticas clínicas, contribuyendo así a la formación de profesionales capacitados para enfrentar los dilemas éticos inherentes a esta nueva era de la bioética en el sigloxxi.

En la figura 2 presentamos una visión general de los dilemas bioéticos que creemos deberán lidiar tanto la sociedad como los diferentes actores implicados en una correcta adaptación de la bioética, con el reconocimiento de que nuevos retos se deberán ir añadiendo a esta rueda de la bioética en SD.

Desafíos éticos en salud digital. Se exploran los desafíos éticos de la IA, la TM, las App móviles (app), los wearables y la IoT (W), desde las perspectivas del sistema de salud (sistema), profesionales de la salud (sanitarios) y personas usuarias (pacientes).

Fuente: elaboración propia.

La rápida implementación de tecnologías como la IA, las App, la TM, los wearables y la IoT en el ámbito de la salud promete innumerables beneficios, pero no sin desafíos éticos significativos. La bioética, lejos de obstaculizar el progreso tecnológico, busca humanizarlo, recordándonos la necesidad crítica de considerar las repercusiones éticas, a medida que avanzamos en la era digital. La historia nos ha mostrado que el debate ético resurgió tras los desastres cometidos muchas veces en pro del progreso científico. No se puede frenar la evolución ni el desarrollo, pero sí tenemos el deber de pensar en las consecuencias a medio y a largo plazo de las acciones e innovaciones que realicemos en el presente, y alertar sobre ello.

Nos enfrentamos a dilemas éticos en cada avance. Así, por ejemplo, la IA demanda directrices sólidas para garantizar la confidencialidad y abordar los sesgos algorítmicos. Las App, aunque empoderan, plantean preguntas sobre el acceso equitativo y la confidencialidad. La TM, aunque busca reducir costos y democratizar servicios médicos, debe garantizar estándares de calidad, evitando amplificar la brecha digital y preservando la confidencialidad. Los wearables y la IoT requieren una gestión ética para preservar la privacidad y evitar acciones perjudiciales.

Desde la perspectiva de la bioética, es imperativo abordar estos desafíos para garantizar prácticas seguras, justas y respetuosas. La formación en bioética se vuelve esencial para profesionales que enfrentarán los desafíos, centrándose en principios como la privacidad, la confidencialidad, la transparencia de datos, la dignidad humana, la prudencia y el respeto a la autonomía. Esta formación debe incorporarse en las facultades, a fin de facilitar herramientas para cuestionar el propósito y las implicaciones éticas de cada avance.

La sociedad se encuentra en la encrucijada de adaptar la bioética al sigloxxi, a fin de no repetir errores del pasado. Al adoptar un enfoque ético, la sociedad puede avanzar hacia un futuro digital que sea más equitativo, seguro y centrado en el bienestar de los individuos. Cada paso debe ser sólido, basado en valores éticos, permitiendo a las generaciones futuras apreciar que el progreso no se dejó nada en el camino, especialmente nuestros principios.

Consideraciones éticasEl artículo no ha conllevado la participación de personas o animales, motivo por el cual no se ha requerido obtener consentimiento de un comité de ética.

Conflicto de interesesLos autores declaran que no tienen conflicto de intereses.