Generative artificial intelligence makes it possible to ask about medical pathologies in dialog boxes. Our objective was to analyze the quality of information about the most common urological pathologies provided by ChatGPT (OpenIA), BARD (Google), and Copilot (Microsoft).

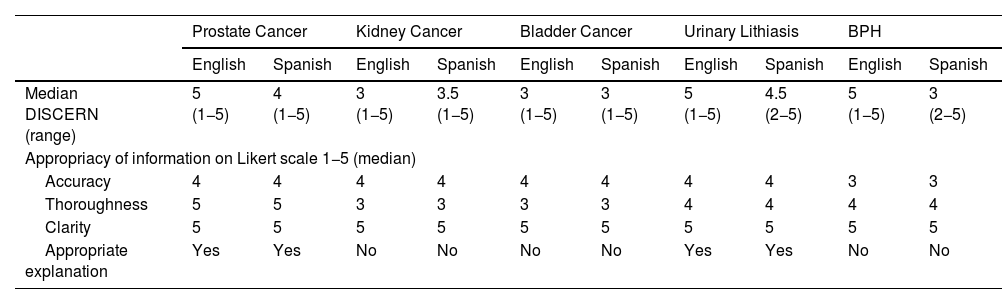

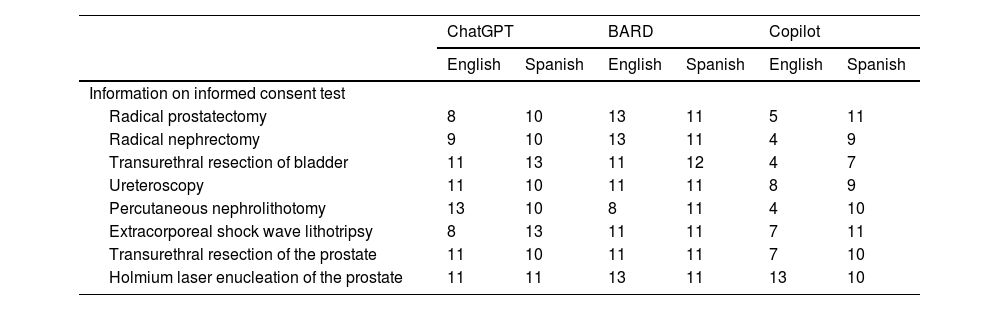

MethodsWe analyzed information on the following pathologies and their treatments as provided by AI: prostate cancer, kidney cancer, bladder cancer, urinary lithiasis, and benign prostatic hypertrophy (BPH). Questions in English and Spanish were posed in dialog boxes; the answers were collected and analyzed with DISCERN questionnaires and the overall appropriateness of the response. Surgical procedures were performed with an informed consent questionnaire.

ResultsThe responses from the three chatbots explained the pathology, detailed risk factors, and described treatments. The difference is that BARD and Copilot provide external information citations, which ChatGPT does not. The highest DISCERN scores, in absolute numbers, were obtained in Copilot; however, on the appropriacy scale it was noted that their responses were not the most appropriate. The best surgical treatment scores were obtained by BARD, followed by ChatGPT, and finally Copilot.

ConclusionsThe answers obtained from generative AI on urological diseases depended on the formulation of the question. The information provided had significant biases, depending on pathology, language, and above all, the dialog box consulted.

La inteligencia artificial (IA) generativa permite preguntar, a través de los cuadros de diálogo, sobre patologías médicas. Nuestro objetivo fue analizar la calidad de la información acerca de las patologías urológicas más comunes en los chatbots ChatGPT de OpenIA, BARD de Google y Copilot de Microsoft.

Material y métodoSe realizó un análisis de la información aportada por IA sobre las siguientes patologías y sus tratamientos: cáncer de próstata, cáncer renal, cáncer de vejiga, litiasis urinarias e hipertrofia benigna de próstata (HBP). A través de cuadros de diálogo se formularon preguntas estructuradas en inglés y en español, recopilando las respuestas para analizarlas posteriormente con cuestionarios DISCERN y sobre la idoneidad global de la respuesta. Los tratamientos quirúrgicos se realizaron con cuestionario de consentimiento informado.

ResultadosLas respuestas obtenidas a través de los tres chatbots explicaron la patología, detallaron los factores de riesgo y describieron los tratamientos. La diferencia radica en que BARD y Copilot aportan citas de información externa, algo que ChatGPT no realiza. Las puntuaciones DISCERN más altas, en números absolutos, se obtuvieron en Copilot; sin embargo, en la escala de idoneidad se objetivó que sus respuestas no fueron las más apropiadas. Las mejores puntuaciones de tratamientos quirúrgicos fueron obtenidas por BARD, seguido de ChatGPT y finalmente de Copilot.

ConclusionesLas respuestas obtenidas de la IA generativa sobre enfermedades urológicas dependieron de la formulación de la pregunta. La información proporcionada presentó sesgos importantes, dependiendo de la patología, del idioma y, sobre todo, del cuadro de diálogo consultado.