La neurociencia podría transformar la educación, pues proporciona nuevos métodos para comprender el aprendizaje y el desarrollo cognitivo, sus mecanismos causales y una forma empírica de evaluar la eficacia de diferentes pedagogías. No obstante, éste sería un objetivo a largo plazo. Desde la neurociencia educativa se debería empezar estudiando cómo los sistemas cognitivos se construyen sobre los sensoriales a lo largo del desarrollo. Aquí me centraré en el lenguaje. Pequeñas diferencias individuales iniciales en una función sensorial, por ejemplo la auditiva, podrían ser el origen de notables diferencias individuales en el desarrollo lingüístico. La neurociencia podría proporcionar una comprensión detallada de los mecanismos causales del desarrollo que vinculan la audición, el desarrollo fonológico y el desarrollo de la alfabetización. Este tipo de investigación neurocientífica básica podría orientar al campo de la educación y la pedagogía explorando los efectos que sobre estos mecanismos ejercen diferentes contextos pedagógicos y de aprendizaje.

Neuroscience has the potential to transform education because it provides novel methods for understanding human learning and cognitive development. It therefore offers deeper understanding of causal mechanisms in learning and an empirical approach to evaluating the efficacy of different pedagogies. However, this will be a long-term enterprise and there will be few immediate pay-offs. Here I set out one possible framework for linking basic research in neuroscience to pedagogical questions in education. I suggest that the developing field of educational neuroscience must first study how sensory systems build cognitive systems over developmental time. I focus on one cognitive system, language, the efficient functioning of which is critical for reading acquisition. Small initial differences in sensory function, for example auditory function, have the potential to cause large differences in linguistic performance over the learning trajectory. The tools offered by neuroscience can enable better understanding of the causal developmental mechanisms linking audition, phonological development and literacy development, in fine-grained detail. Following this basic research, neuroscience can then inform education and pedagogy by exploring the effects on these neural mechanisms of different learning contexts and pedagogies.

En la medicina y en los tratamientos médicos se han producido notables avances a medida que se ha ido mejorando la comprensión de la fisiología corporal. Es probable que se produzcan notables avances en la educación y la eficacia pedagógica a medida que vayamos comprendiendo mejor la fisiología del aprendizaje, que está siendo estudiada por neurocientíficos, quienes están descubriendo unos mecanismos que se asemejan a las “leyes generales del aprendizaje” propuestas hace tiempo desde la psicología. En educación, sin embargo, es normal cuestionar la validez del propio concepto de leyes generales del aprendizaje, sobre la base de que el aprendizaje y las capacidades de los individuos están inextricablemente unidos a contextos y situaciones de aprendizaje (Wells y Claxton, 2002). Sin embargo, cuando entendamos cómo ocurre el aprendizaje en el cerebro para los diferentes dominios de relevancia educativa, podremos estudiar los efectos de diferentes contextos y situaciones sobre el aprendizaje dentro de un dominio particular. Podemos evaluar directamente los efectos de diferentes ámbitos de aprendizaje sobre la fisiología del cerebro. En principio, esta aproximación permite el desarrollo de una base empírica para la educación, investigando los efectos de diferentes pedagogías y su impacto sobre el aprendizaje en diferentes contextos y situaciones. Sin duda, si la educación quisiera adherirse a las promesas de la neurociencia, sería posible estudiar cuestiones educativas clave usando aproximaciones científicas y neurocientíficas tradicionales.

Hasta la fecha ha existido un gran escepticismo entre algunos investigadores del ámbito educativo sobre el valor de esta perspectiva en su totalidad. Algunos han argumentado que acercarse a la educación a través del examen empírico de la fisiología cerebral confunde “cuestiones que tienen que ver con la naturaleza del conocimiento y cómo aprendemos, lo que constituye un ser humano y su buen hacer” (Cigman y Davis, 2009, p. ix). Así, los métodos “reduccionistas” de la neurociencia se consideran una metodología inadecuada para mejorar nuestro conocimiento de la esencia humana. “¿Exactamente, en qué se sustenta la autoridad de la neurociencia para hacer afirmaciones sobre la naturaleza del aprendizaje?” (Cigman y Davis, 2009, p. 76).

En este artículo, elaborado a partir de una conferencia inaugural en el Centre for Educational Neuroscience de Londres, intentaré mostrar a través del ejemplo ilustrativo de la investigación en lectura/dislexia que la neurociencia tiene “autoridad” para realizar descubrimientos fisiológicos susceptibles de comprobación empírica y falsación. Espero demostrar que el uso de estos métodos “reduccionistas” puede enriquecer considerablemente nuestra comprensión del aprendizaje en niños y cómo desarrollar su potencial de la mejor manera posible. Comenzaré revisando brevemente lo que sabemos acerca de la lectura y su desarrollo desde la investigación educativa y psicológica. A continuación me centraré en los procesos sensoriales básicos que probablemente subyazcan a algunos de los factores clave del desarrollo identificados por este tipo de investigaciones. Describiré los modelos de procesamiento sensorial básico que considero relevantes para comprender el desarrollo del lenguaje y mostraré cómo pueden aplicarse sistemáticamente estos modelos al estudio de factores causales del desarrollo y por tanto para proponer pedagogías efectivas en la enseñanza de la lectura.

Mi objetivo general es proporcionar un esquema verosímil de cómo puede utilizarse la neurociencia educativa para ayudar en la práctica educativa. Este esquema se basa en una serie de principios que he encontrado útiles en mi propia investigación. En primer lugar, deberíamos preguntarnos qué sabemos a partir de la investigación comportamental disponible sobre un determinado aspecto educativo, como por ejemplo la lectura, el cálculo, la atención o la motivación de logro. En segundo lugar, como la neurociencia es ideal para el estudio de procesos sensoriales básicos, deberíamos preguntarnos qué procesos sensoriales son probablemente importantes a la hora de explicar las diferencias individuales. En tercer lugar, deberíamos ver si la investigación actual en neurociencia nos ofrece modelos teóricos relevantes sobre el desarrollo y, a continuación, deberíamos comprobar si estos modelos propician predicciones contrastables sobre las funciones sensoriales y cognitivas a lo largo del desarrollo. Por último, necesitamos decidir cómo poner a prueba estas predicciones mediante las técnicas de neuroimagen en niños. En el campo de la lectura y la dislexia, mi conclusión será que la neurociencia ofrece ideas y métodos muy relevantes para poner a prueba la eficacia de aproximaciones pedagógicas educativas centradas en la importancia del lenguaje oral. Algunos autores sugieren que el juego lingüístico, la poesía, las nanas, las canciones infantiles e incluso el entrenamiento musical son de suma importancia para labrar la imaginación de los niños (Styles, Joy y Whitley, 2010). Aquí argumentaré que, gracias a los estudios neurocientíficos con biofeedback, ahora disponemos de medios tecnológicos con los que podemos medir también si estas aproximaciones afectan a los mecanismos neuronales relevantes en el desarrollo del lenguaje y de la alfabetización.

¿Qué sabemos actualmente?La adquisición de la lectura en niños viene determinada, en todos los idiomas, por diferencias individuales en la toma de conciencia por parte de los niños de las estructuras fonológicas (basadas en el sonido) del lenguaje (Ziegler y Goswami, 2005). La investigación psicológica y educativa ha demostrado esto pidiendo a niños pre-lectores y lectores que completen tareas orales simples tales como contar el número de sílabas de las palabras (2 sílabas en “gancho”, 3 sílabas en “radio”), decidiendo si dos palabras riman (“gato-pato”, sí, “gato-gota”, no) y si empiezan con el mismo sonido (“mar” “muro” – sí). La ejecución en estas tareas es predictiva de la capacidad lectora tanto en lenguajes alfabéticos, como el inglés o el alemán (p. ej., Frith, Wimmer y Landerl, 1998), como en lenguajes no alfabéticos como el chino (p. ej., Siok y Fletcher, 2001). Más recientemente, se ha demostrado que la conciencia fonológica “suprasegmental” también es importante a la hora de explicar diferencias individuales en la lectura (Goswami, Gerson y Astruc, 2010; Whalley y Hansen, 2006; Wood y Terrell, 1998). La conciencia suprasegmental se refiere a la conciencia de los patrones prosódicos y de entonación que caracterizan al habla conectada cuando la unidad de análisis fonológico es la oración o frase completa y no la palabra. De hecho, existen investigaciones que sugieren que a medida que se desarrolla un léxico de formas de palabra habladas, tanto la información fonética (“segmental”) como la prosódica (“suprasegmental”) están inextricablemente unidas entre sí en cuanto a la información fonológica almacenada por el cerebro para cada forma de palabra (p. ej., Pierrehumbert, 2003).

La estructura fonológica diferirá entre lenguas, obviamente, de manera que los predictores fonológicos de una alfabetización eficiente también serán diferentes. Por ejemplo, el chino es un lenguaje tonal. Sílabas idénticas poseen significados diferentes cuando se expresan con entonaciones diferentes (p. ej., subir el tono a lo largo de la sílaba vs. mantener el tono a lo largo de la sílaba). Para lenguajes como el chino, como cabría esperar, la conciencia del tono es también un predictor importante de la adquisición de la alfabetización (p. ej., McBride-Chang, Shu, Zhou, Wat, & Wagner, 2003). Al igual que ocurre con las habilidades fonológicas, las diferencias individuales en otros aspectos de la conciencia lingüística también pueden ser importantes para la alfabetización. Un ejemplo es la conciencia morfológica, donde los niños tienen que prestar atención a los significados de las palabras (p. ej., ¿cómo se llama el árbol en el que crecen los zapatos? - La horma) [en el original en inglés se juega con el doble significado de la palabra ‘tree’, que significa árbol y horma de zapato: “What is a tree that grows shoes called? A shoe tree”]. Como se puede ver, todas estas habilidades que son predictivas de la alfabetización están basadas en tareas de procesamiento lingüístico oral. El input para el análisis del niño es un patrón sonoro o un grupo de patrones sonoros. Actualmente se cree que la unidad perceptiva esencial que refleja estas estructuras en todas las lenguas es la sílaba y no el fonema (p. ej., Greenberg, 2006; Port, 2007).

Asimismo, estas diferentes habilidades fonológicas y de otro tipo se muestran mermadas en niños con dislexia del desarrollo. El mejor predictor en todas las lenguas de quién tendrá problemas para adquirir la ortografía de su idioma es la conciencia fonológica (Ziegler y Goswami, 2005; Ziegler et al., 2010). Este es el caso independientemente de que el sistema ortográfico sea alfabético y trabaje en el ‘grano fino’ del fonema o de que use caracteres que puedan corresponder a ‘granos más gruesos’ tales como las sílabas (como en el kana japonés) o incluso palabras enteras (como en el kanji chino). Los niños con dislexia en lenguas tan diversas fonológica y ortográficamente como el inglés, el italiano y el chino muestran todos ellos dificultades fonológicas (Ziegler y Goswami, 2005, para una visión general). A pesar de las diferencias fonológicas y ortográficas que existen entre las distintas lenguas, los trabajos actuales en neurociencia cognitiva sugieren que los sistemas neuronales esenciales que se activan tanto durante el procesamiento del lenguaje como durante el procesamiento ortográfico (lectura) son muy similares en todas las lenguas (véase Price y McCrory, 2005, para una discusión general). Las redes neuronales que se activan durante tareas de lenguaje y de lectura en diferentes lenguajes son en gran medida las mismas estructuras fisiológicas. Por tanto, si queremos comprender los procesos sensoriales que subyacen al desarrollo del sistema cognitivo que se emplea en ser lector, que es el lenguaje hablado, una forma de hacerlo es estudiar cómo codifica el cerebro las entradas sonoras, tanto lingüísticas como no lingüísticas. Esta perspectiva asume que la alfabetización es dependiente de la eficacia en el procesamiento del lenguaje oral y no supone la existencia de procesos neuronales adicionales (p. ej., Krafnick, Flowers, Napoliello y Eden, 2011). Aquí no tendré en cuenta el procesamiento visual, que lógicamente es también importante para el aprendizaje de la lectura (Blomert, 2011), si bien las habilidades visuales no parecen relacionarse de forma sistemática con las diferencias individuales en la capacidad lectora (Vellutino, Fletcher, Snowling y Scanlon, 2004).

¿Qué procesos sensoriales es probable que sean importantes?El sentido primario que subyace a la percepción del habla es el auditivo. Investigaciones recientes han mostrado que los bebés escuchan hablar incluso estando en el útero, si bien lo que mejor escuchan son las modulaciones de baja frecuencia del habla. Escuchar modulaciones de baja frecuencia es similar a escuchar a alguien hablando bajo el agua –la estructura silábica básica de su habla se puede percibir, pero no siempre las palabras exactas. Estas investigaciones sugieren que los bebés nacen con algún tipo de conciencia de los patrones rítmicos característicos de su lengua nativa, el lenguaje que ya han escuchado cuando su madre hablaba, y de hecho los neonatos pueden distinguir su lengua nativa de otras lenguas, así como lenguas con clases diferentes de ritmos. Por ejemplo, los niños de 4 días son sensibles a las diferencias en ritmo y prosodia que caracterizan al holandés frente al japonés (Mehler et al., 1988). Una vez que el bebé interactúa con sus interlocutores sociales, sin embargo, las claves proporcionadas por la información visual de los labios, la mandíbula y las mejillas complementan la información auditiva por otras vías importantes (p. ej., Kuhl, 2004). Estas habilidades de “lectura del habla” son importantes para un procesamiento eficiente del lenguaje oral, no solo para individuos sordos, que no tienen acceso a ningún tipo de información auditiva. Esto se puede comprobar fácilmente en el “efecto cocktail”, por el que resulta más fácil seguir una conversación en un ambiente ruidoso cuando puedes ver la boca del hablante mientras escuchas lo que dice. Resulta interesante que la neurociencia de la audición muestre que un aspecto fundamental de la información visual con respecto a la inteligibilidad del habla es la información visoespacial de baja frecuencia de los movimientos de apertura y cierre de la mandíbula. Cuando abrimos y cerramos las mandíbulas para producir sílabas, se genera una información visual dinámica de baja frecuencia centrada en torno a 4Hz (Chandrasekaran, Trubanova, Stillittano, Caplier y Ghazanfar, 2009). La información auditiva de baja frecuencia en el habla se corresponde con la estructura silábica y ronda los 4-6Hz (Drullman, 2006). Por lo tanto, aquí convergen mecanismos fisiológicos auditivos y visuales para aumentar la eficacia en el procesamiento del lenguaje, tanto en términos perceptivos como motores, pues los bebés aprenden a producir un lenguaje hablado que pueda ser interpretado por sus interlocutores sociales.

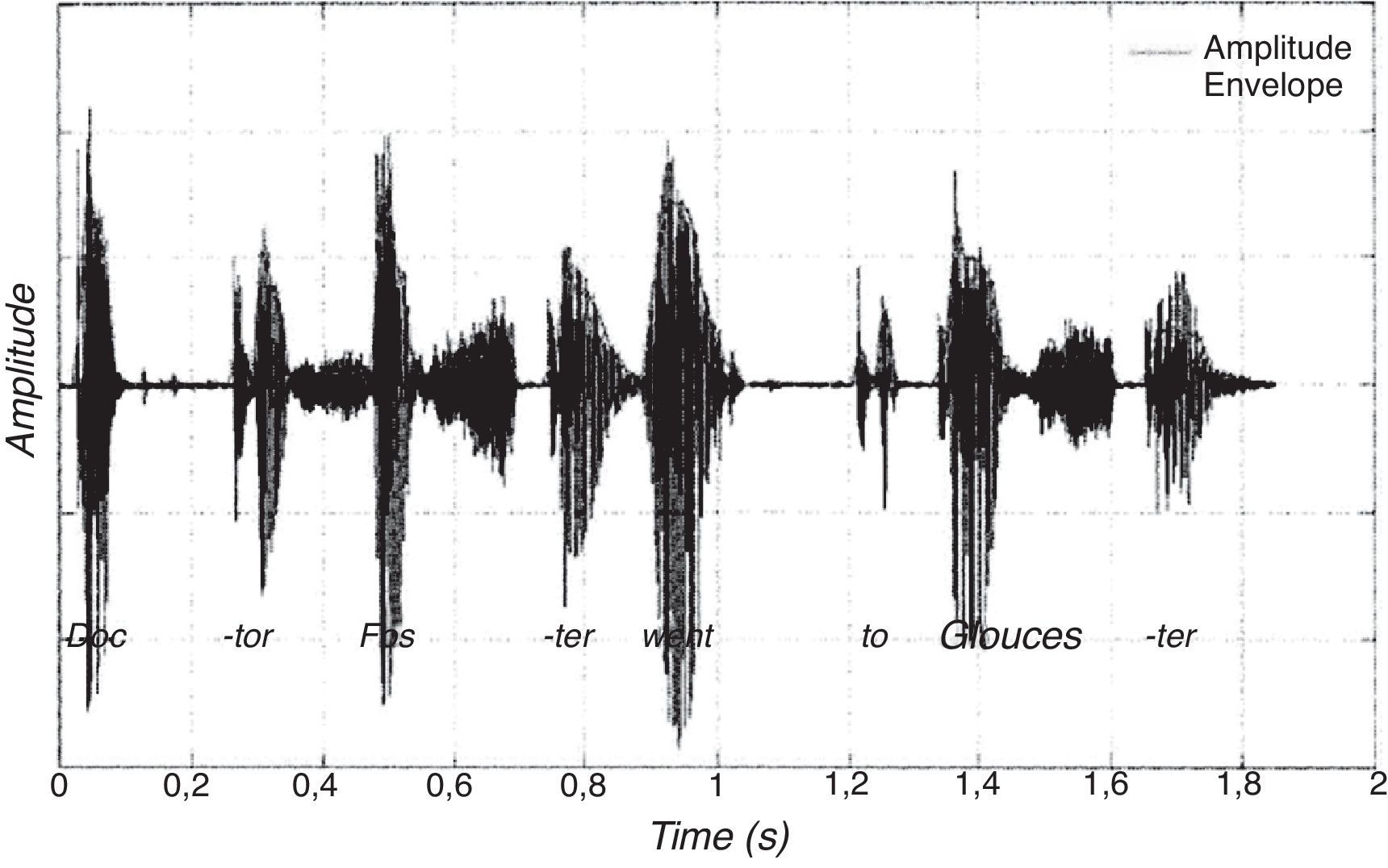

La investigación sobre las diferencias individuales en las habilidades de procesamiento auditivo básico sugiere que algunos procesos auditivos básicos están alterados en niños con dislexia del desarrollo (Goswami, 2009, para una visión general). En lugar de revisar todo el campo (véase Hämäläinen, Salminen y Leppänen, 2013, para una revisión reciente), aquí me centraré en nuestra propia investigación, que aporta datos neurocientíficos relevantes respecto al encadenamiento silábico del flujo del habla y a la percepción de la información de baja frecuencia, que discutiré en detalle posteriormente. A lo largo de la pasada década hemos llevado a cabo una serie de estudios que sugieren que las dificultades auditivas primarias de los niños con problemas de lectura o del habla implican al procesamiento de la envolvente de amplitud (Corriveau y Goswami, 2009; Corriveau, Pasquini y Goswami, 2007; Goswami, 2009; Goswami et al., 2010; Goswami et al., 2002; Goswami, Wang et al., 2011; Muneaux, Ziegler, Truc, Thomson y Goswami, 2004; Pasquini, Corriveau y Goswami, 2007; Thomson, Fryer, Maltby y Goswami, 2006; Thomson y Goswami, 2008; Richardson, Thomson, Scott y Goswami, 2004). La envolvente de amplitud del habla se refiere a las fluctuaciones en la intensidad del sonido que llegan a los tímpanos cuando escuchamos el lenguaje hablado (véase la fig. 1). A medida que se produce el habla, la energía (o amplitud, cantidad de sonido generada por el hablante) aumenta y disminuye a medida que se producen las sílabas y las mandíbulas se abren y cierran. El oído detecta las diferentes bandas de frecuencia del habla contenidas en el perfil de amplitud y usa tanto la información de amplitud (intensidad sonora) como la de frecuencia para codificar la señal. Neuronalmente, el sistema auditivo codifica la modulación de la amplitud en sonidos naturales tanto a lo largo de diferentes bandas de frecuencia como a diferentes escalas temporales (Joris, Schreiner y Rees, 2004). Cuando se produce una sílaba, la energía aumentará cuando se abre la boca, mostrando su mayor valor en el momento de producción de la vocal, de ahí que las sílabas puedan ser descritas como “arcos de energía” (Greenberg, 2006). El tiempo de subida hasta la vocal, es decir, del comienzo de la envolvente de amplitud asociada con una sílaba particular, es un elemento crucial de la señal hablada que facilita la segmentación temporal de dicha señal en sílabas. El tiempo de subida también se relaciona con las características de la sílaba: el tiempo de subida será rápido si la sílaba comienza con un sonido implosivo, como BA, y lento si la sílaba comienza con un sonido más sonoro, como WA (Goswami, Fosker, Huss, Mead, & Szücs, 2011). Conductualmente, el tiempo de subida también se relaciona con el tiempo del ritmo, tanto en el lenguaje como en la música, en todas las lenguas, sean del tipo de ritmo que sean, tanto en la percepción como en la producción (Gordon, 1987; Hoequist, 1983; Morton, Marcus y Frankish, 1976; Scott, 1998a). En nuestros estudios hemos evaluado el procesamiento del tiempo de subida, de la duración, la intensidad y la frecuencia de tonos no lingüísticos en niños con un desarrollo típico y lo hemos comparado con los resultados obtenidos en niños con dislexia del desarrollo o con trastorno específico del lenguaje (TEL). Nuestros datos muestran que las dificultades en el procesamiento fonológico que encontramos en ambos trastornos del desarrollo están íntimamente relacionadas con un deficiente procesamiento auditivo básico del tiempo de subida.

Muestra esquemática de la forma de la onda correspondiente a la primera oración de la canción infantil tradicional inglesa “Doctor Foster went to Gloucester”, con la envolvente de amplitud (amplitud envolvente) marcada en gris, mostrando que las sílabas acentuadas (“Doc”, “Fos”, “went” y “Glos”) tienden a producirse con mayor intensidad que las sílabas no acentuadas.

La existencia de dificultades en la percepción del tiempo de subida sugiere la presencia de dificultades para distinguir los diferentes rangos de modulación de las frecuencias del habla (Goswami, 2011). En nuestros estudios, las diferencias individuales en la severidad de las deficiencias en el tiempo de subida son altamente predictivas del grado de deficiencia fonológica que encontramos en los diferentes niños. Hemos interpretado estos resultados como prueba de que la percepción del tiempo de subida es crucial para el desarrollo de las representaciones fonológicas de alta calidad del lenguaje, necesarias para la adquisición de la alfabetización. Históricamente, el tiempo de subida se había asociado con la experiencia perceptiva del ritmo y la entonación del lenguaje. El tiempo de subida es fundamental para la percepción de la prosodia (Greenberg, 2006), aunque no sea mencionado en las teorías clásicas de la percepción prosódica (que asumen que los cambios en la frecuencia fundamental, la duración y la amplitud gobiernan la percepción de la prosodia, teniendo la frecuencia fundamental el papel protagonista, p. ej., Fry, 1954). La discriminación del tiempo de subida es deficiente en niños con dislexia que hablan inglés, francés, húngaro, español, chino y finés (Goswami et al., 2002; Goswami, Wang et al., 2011; Hämäläinen et al., 2009; Muneaux et al., 2004; Richardson, Thombon, Scott y Goswami, 2004; Surányi et al., 2009). El tiempo de subida es un predictor significativo de la conciencia fonológica correspondiente a estos lenguajes (p. ej., conciencia del ritmo en inglés, vs. conciencia del tono léxico [subida o bajada del tono de la sílaba] en chino). También está muy asociado con la conciencia prosódica y rítmica, como se discutirá posteriormente.

¿Existe un buen modelo neurocientífico del desarrollo?La neurociencia de la audición ofrece una serie de modelos que permiten comprender cómo se puede representar y codificar la información sensorial auditiva en las áreas del cerebro que están activas durante el procesamiento lingüístico. Discutiré uno de estos modelos en profundidad, pues en mi opinión es sumamente relevante para comprender los vínculos causales existentes entre el procesamiento sensorial auditivo básico, el desarrollo de la conciencia fonológica y las habilidades lingüísticas orales, y por tanto la adquisición de la lectura y la dislexia. Se trata del modelo del procesamiento de lenguaje de resolución multi-temporal de Hickok y Poeppel (2007; véase también Poeppel, Idsardi y van Wassenhove, 2008). Según dicho modelo, basado en sus propias investigaciones así como en multitud de otros datos, en la organización cortical del procesamiento del habla intervienen dos sistemas, el ventral y el dorsal. El sistema ventral procesa las señales lingüísticas para la comprensión, mientras que el dorsal vincula las señales acústicas del habla con redes articulatorias del lóbulo frontal. El habla es una señal que el cerebro procesa a lo largo del tiempo y es una señal temporalmente compleja. Muchas frecuencias varían a diferentes escalas temporales y a diferentes intensidades. Hickok y Poeppel por tanto proponen que la corteza procesa el habla en múltiples escalas temporales simultáneamente. Se cree que esto se consigue a partir de las oscilaciones neurales, que discutiremos más adelante. Por ahora, lo que quiero destacar es que su modelo postula dos tasas temporales clave, una “suprasegmental” o silábica (con una ventana larga de integración temporal de entre 150 y 300ms) y una tasa “segmental” o “fonémica” (sonido lingüístico), con una ventana de integración temporal corta de en torno a 20-50ms. En su modelo, la escala temporal larga conlleva claves respecto a los límites silábicos y la tasa de sílabas. También contiene información tonal, claves prosódicas y claves de acentuación. La tasa temporal más corta se necesita para determinar el orden de los segmentos sonoros del habla (p. ej., en la palabra “potrillo” frente a “portillo”). La escala temporal más corta también se relaciona con las características que varían cuando producimos diferentes sonidos, tales como el tiempo de inicio de la sonoridad [en inglés, “voice onset time”] (la diferencia en el inicio de la vibración de las cuerdas vocales cuando producimos/b/vs./p/, que varía en torno a 40ms). De esta manera, durante el desarrollo, ambas escalas temporales están íntimamente relacionadas no solo con la percepción del habla (p. ej., de sílabas vs. fonemas), sino también con la producción del habla (p. ej., de sílabas vs. variables fonéticas).

Se piensa que las diferentes escalas temporales se “unifican” cuando se percibe el habla, posibilitando que las entradas de otras modalidades sensoriales también contribuyan a la percepción del habla (p. ej., las claves visuales procedentes de los movimientos de labios y mejillas ya comentadas). Adviértase que “unificar” es un concepto utilizado de muy diferentes maneras dentro de la neurociencia y que Hickok y Poeppel (2007) se refieren a algo distinto de lo que expone Blomert (2011) cuando discute sobre la unificación. Pensando en este modelo en relación al desarrollo fonológico de los niños, parece evidente que al menos 3 tipos de información sensorial deberían ser importantes durante el desarrollo. Se trata de la integración temporal de la sílaba a escalas temporales más largas, la integración temporal del fonema a escalas temporales más cortas y la integración intermodal audiovisual (AV) o unificación AV. Por tanto, cabe esperar que una ineficacia neural en el procesamiento de uno cualquiera de estos aspectos de la información sensorial afecte al curso del desarrollo durante el desarrollo fonológico. De nuevo, necesitamos tener en cuenta lo que ya sabemos. De hecho, estudios realizados con niños muestran que los bebés con un desarrollo típico procesan ambas escalas temporales del habla desde el nacimiento. Como ya hemos señalado, los niños recién nacidos pueden distinguir lenguas en función de sus propiedades silábicas o rítmicas y los niños evaluados en el primer mes de vida también pueden discriminar diferencias fonéticas en la información contenida en ventanas temporales cortas, por ejemplo la discriminación entre “ba” y “pa” (Eimas, Siqueland, Jusczyk y Vigorito, 1971). Finalmente, los niños pequeños están muy capacitados para detectar contrastes auditivo-visuales en el habla, por ejemplo enfadándose y llorando si se les hacer ver un video de una cabeza hablando desincronizadamente con respecto a lo que están oyendo (Dodd, 1979).

¿Cómo codifica el cerebro la información a estas diferentes escalas? Una serie de estudios recientes en animales utilizando registros electrofisiológicos unicelulares en las cortezas sensoriales primarias y multisensoriales muestran que el cerebro utiliza procesos oscilatorios a diferentes escalas temporales para maximizar la fuerza de representación de la información. En humanos y en relación al habla, parece probable que las oscilaciones neuroeléctricas en las diferentes bandas de frecuencia segmentan eficazmente el habla entrante en “paquetes” de información de diferentes “granos”. Estos paquetes de información, tales como la sílaba vs. la variable fonética, se pueden contrastar con representaciones almacenadas y así ser interpretados. A través de la sincronización de fase (acoplamiento rítmico) a las frecuencias entrantes, el cerebro puede seguir la dinámica del habla por encima de la variabilidad entre hablantes (la tasa de habla variará en función del hablante, pero los paquetes de información proporcionados por cada hablante estarán organizados en base a las distintas escalas temporales dentro de la envolvente de amplitud del habla de un individuo, p. ej., sílabas, variables fonéticas, etc.). De esta manera, la corteza auditiva analiza y discrimina las oraciones habladas, permitiendo así la comprensión del habla.

Los datos en animales sugieren que los diferentes ritmos oscilatorios remiten a diferentes “labores” de integración de la señal sensorial (p. ej., Kayser, Petkov y Logothetis, 2008; Lakatos, Chen, O’Connell, Mills y Schroeder, 2007). Por ejemplo, las oscilaciones de baja frecuencia gobiernan las influencias de la corteza auaditiva sobre el área multimodal para la unificación auditivo-visual, el surco temporal superior (STS). Las oscilaciones de más alta frecuencia gobiernan las influencias del STS sobre la corteza auditiva (Kayser y Logothetis, 2009). La codificación temporal es por lo tanto utilizada junto con la codificación espacial (es decir, qué poblaciones de neuronas están activas) para maximizar la representación de la información sensorial. Sabemos que hay diferentes frecuencias oscilatorias en el cerebro humano gracias a los estudios de EEG (electroencefalografía1). Estos estudios muestran la existencia de actividad eléctrica en diferentes bandas de frecuencia en el cerebro en reposo (p. ej., delta, 0.5-4Hz, theta, 4-8Hz, gamma, 30-80Hz; véase Buzsaki, 2006). Más recientemente, se ha despertado un gran interés respecto a si diferentes redes neuronales del cerebro oscilan preferentemente a determinadas frecuencias, lo que les facilitaría la codificación de la información sensorial entrante mediante su “ajuste de fase” o acoplamiento a las mismas frecuencias que el input. El input auditivo contiene frecuencias temporales muy diversas y el input visual contiene frecuencias espaciales muy diversas.

Durante la percepción del habla, los estudios de neurociencia cognitiva en adultos sugieren que el que aquella esté “ajustada en fase” (cuando la fase de una señal oscilante se acopla a la fase o tiempo de una señal [input] de referencia) en la frecuencia theta en el giro de Heschl determina el encadenamiento silábico del habla y su inteligibilidad subsiguiente (Luo y Poeppel, 2007). El giro de Heschl se encuentra en el la corteza auditiva primaria, y la frecuencia theta es aproximadamente la frecuencia en la que se producen las sílabas en todas las lenguas del mundo (véase Poeppel et al., 2008). Se piensa que redes neurales en esta área de la corteza auditiva utilizan elementos de la señal entrante tales como los tiempos de subida para reajustar su actividad oscilatoria, de manera que su frecuencia oscilatoria natural esté en fase con el input, lo que potencia el procesamiento sensorial (véase Goswami, 2011). En el modelo de resolución multi-tiempo (Hickok y Poeppel, 2007), las redes neurales que muestrean la entrada a frecuencias rápidas (gamma) y lentas (theta) se asumen como subyacentes a ventanas de integración temporal para el habla rápidas vs. lentas. Por ejemplo, Luo y Poeppel (2007) demostraron usando la MEG (magnoencefalografía1) que el patrón de fase de las respuestas en banda theta (4-8Hz) registradas en la corteza auditiva humana procesaban y discriminaban las oraciones habladas de forma fiable. El periodo de la oscilación theta (una ventana temporal de unos 200ms) parecía reajustarse a la información entrante del habla para procesar su dinámica, permitiendo la segmentación de la señal entrante en unidades del tamaño de una sílaba que podrían ser utilizadas para acceder a las formas auditivas de las palabras del léxico mental. Luo y Poeppel defendieron, a la vista de sus datos, que la sílaba sería un primitivo computacional en el procesamiento cortical del habla, una sugerencia que es respaldada por los más recientes trabajos tanto sobre máquinas de reconocimiento lingüístico como por la propia lingüística (Greenberg, 2006). A pesar de sus evidentes implicaciones para la pedagogía, esta perspectiva aún necesita asentarse en la educación de la lectura así como en los estudios conductuales sobre lectura.

¿Permite el modelo neurocientífico predecir el comportamiento?Ahora utilizaremos este marco conceptual de la neurociencia de la audición para hacer predicciones sobre el comportamiento de los niños. Por ejemplo, a nivel cerebral podemos explorar si la percepción silábica y la inteligibilidad del habla están relacionadas con el patrón de fase de la banda theta, tanto en niños como en bebés. Los bebés reconocen su propio nombre en torno a los 4 meses de edad y producen sus primeras palabras en torno a los 9 meses (Bortfeld, Morgan, Golinkoff y Rathbun, 2005; Fenson et al., 1994). Dado que tanto la frecuencia oscilatoria theta como la gamma parecen intrínsecas a la corteza auditiva humana (Giraud et al., 2008), los fenómenos de reacoplamiento y sincronización de fase podrían estudiarse en el primer año de vida y relacionarse con el desarrollo lingüístico y fonológico (Telkemeyer et al., 2011). Dichas medidas también podrían proporcionar marcadores neurales del riesgo de desórdenes fonológicos tales como la dislexia (Lyytinen et al., 2001), al igual que la sensibilidad al tiempo de subida medida en las primeras fases del desarrollo (Goswami, 2009). También podemos explorar si la eficacia del ajuste de fase en el giro de Heschl predice el desarrollo lingüístico y fonológico de los niños, así como si el ajuste de fase a la envolvente de amplitud del habla es deficiente en la dislexia. De hecho, ya existe alguna evidencia a favor de esta última predicción. Abrams, Nicol, Zecker y Kraus (2009) usaron EEG para medir el ajuste de fase al habla correlacionando la respuesta obtenida en electrodos situados sobre la corteza temporal (que contiene al giro de Heschl) con la envolvente general de frecuencias de una oración repetida cientos de veces (“el chico joven abandonó su casa”). Se encontró que los malos lectores de 12 años mostraban un deficiente acoplamiento de fase a esta oración. Además, se observaron diferencias interhemisféricas en el tiempo de ajuste de fase en función de las habilidades lectoras. Los lectores de 12 años con un desarrollo típico mostraban que el acoplamiento empezaba antes en el hemisferio derecho, lo que estaría de acuerdo con el modelo de Hickok y Poeppel (2007). Por contra, en los malos lectores el acoplamiento comenzaba antes en su hemisferio izquierdo. Esta asimetría cortical explicaba el 50% de la varianza en las habilidades lectoras de los niños.

A nivel comportamental, podríamos esperar que los niños con dislexia mostraran dificultades fonológicas relacionadas con aspectos suprasegmentales del habla, tales como dificultades prosódicas y de acento silábico. Estas dificultades fonológicas aparecerían para todo tipo de tareas lingüísticas métricas (la estructura métrica se refiere a la alternancia de “golpes” silábicos fuertes y débiles en el lenguaje). De hecho, las dificultades pueden aparecer también en otras tareas rítmicas que impliquen estructura métrica, tales como tareas musicales o incluso tareas simples de percepción rítmica que también requieran un ajuste o acoplamiento de fase apropiado al input rítmico por parte de la redes neurales auditivas. Un ejemplo sería el golpear en tiempo respecto a un ritmo. La investigación más reciente avala al menos algunas de estas predicciones.

La percepción prosódica puede medirse mediante tareas de lenguaje reiterativas, en las que las sílabas fuertes se sustituyen por “Di” y las débiles por “di” (de manera que, p. ej., “cajón azul” se convierte en diDididi; Kitzen, 2001). Los niños con dislexia a los que se les administra una tarea DiDi muestran un pobre reconocimiento de fotografías de famosos mencionadas en “Didis” (Harry Potter como DidiDidi; véase Goswami et al., 2010). Las diferencias individuales en la sensibilidad a la estructura DiDi se podían predecir en función de la capacidad de discriminación de los tiempos de subida. La percepción del acento silábico también se puede medir directamente. En un estudio se pidió a un grupo de disléxicos adultos que juzgaran si dos palabras de 4 sílabas se acentuaban de la misma manera (p. ej., “paréntesis”, “ridículo”; Leong, Hämälälinen, Soltesz y Goswami, 2011). Los adultos con dislexia fueron significativamente menos sensibles a la acentuación silábica y las diferencias individuales en dicha sensibilidad se podían predecir a partir de la discriminación del tiempo de subida y no por otras medidas auditivas (discriminación de la frecuencia o de la intensidad). En datos sin publicar, también hemos encontrado que la imitación de la entonación silábica débil-fuerte y fuerte-débil se encuentra mermada en niños con dislexia, que también fueron peores a la hora de usar la acentuación para diferenciar MAma (fuerte-débil) de maMA (débil-fuerte; Huss y Goswami, datos sin publicar).

Respecto a déficits rítmicos más generales, mantener el ritmo de un metrónomo golpeando con los dedos (acoplamiento rítmico) parece estar empobrecido para las tasas relevantes para las sílabas en la dislexia del desarrollo (Thomson y Goswami, 2008; Thomson, Fryer, Maltby y Goswami, 2006). Se pidió a niños y adultos con dislexia que golpearan síncronamente a ritmos a una tasa de 1.5Hz (666ms), 2Hz (500ms) y 2.5Hz (400ms). Mientras que todos los niños mostraban dificultades a 1.5Hz (666ms), sólo los niños con dislexia también mostraban dificultades a 2.5Hz (400ms) y a 2Hz (500ms). Los adultos con dislexia, por su parte, mostraban dificultades a 1.5Hz y a 2Hz en comparación con lectores normales, pero no a 2.5Hz. Las diferencias individuales en el acoplamiento rítmico se podían predecir a partir de la discriminación del tiempo de subida, tanto en niños como en adultos. En una tarea musical métrica, en la que “melodías” cortas que contenían tres repeticiones de frases de 2-5 notas se presentaban a niños con y sin dislexia en un paradigma de juicio semejante-diferente, se encontró una sensibilidad a la estructura métrica significativamente menor en los niños con dislexia (Huss, Verney, Fosker, Fegan y Goswami, 2011). Aunque la complejidad métrica se variaba ubicando la nota más baja en la primera, segunda o tercera posición y utilizando secuencias con notas de diferente longitud (aunque no de diferente longitud perceptiva general), los niños con dislexia mostraban perores resultados a la hora de determinar si dos melodías eran la misma incluso para las secuencias más fáciles (p. ej., 2 notas alternando 3 veces, con un aumento de la duración entre las notas en la segunda presentación de la melodía). En el estudio de Huss et al. (2011) fue la discriminación del tiempo de subida más que de la duración lo que predijo las diferencias individuales.

¿Qué técnicas de imagen cerebral son más relevantes para su uso en pedagogía?Cualquier input ambiental, incluyendo los ambientes de aprendizaje ofrecidos en entornos educativos, afectará a los procesos fisiológicos del cerebro. Respecto a la estructura conceptual desarrollada hasta ahora, parecería del mayor interés poder comprender hasta qué punto las prácticas tradicionales utilizadas en las escuelas infantiles, tales como las canciones infantiles (que normalmente son poemas métricos), o el uso de la poesía en las canciones y en el aprendizaje afectan a los procesos fisiológicos que parecen (según los análisis expuestos aquí) ser importantes para percibir las estructuras silábica y métrica del lenguaje. Sería de mayor interés indagar si las practicas pedagógicas basadas en juegos lingüísticos (tales como juegos rítmicos, juegos de sílabas) o en la combinación de movimientos motores con lenguaje (dar una palmada por cada sílaba, marchar al ritmo de sílabas) o en cantar con música (donde la estructura temporal de la música debe coordinarse con la estructura temporal del lenguaje mediante alineamiento estructural rítmico) modulan la actividad de las redes oscilatorias theta medidas por Luo y Poeppel (2007). Hipotéticamente, estas actividades educativas deberían sincronizar las oscilaciones a frecuencias bajas en el giro de Heschl (theta y delta), que parecen ajustadas en fase a los patrones rítmicos silábicos y de entonación del habla. La predicción sería que la eficacia en el ajuste de fase (es decir, acoplamiento) de estas oscilaciones theta mejoraría en los niños mediante el juego lingüístico. Si estas formas de juego lingüístico realmente mejoran el ajuste de fase de theta en la corteza auditiva y si esta mejora está vinculada con una conciencia fonológica mayor, entonces la neurociencia educacional habrá proporcionado una evidencia contundente de que esas pedagogías son importantes para una educación eficiente de la alfabetización en los primeros años. Una aproximación neurocientífica permitiría por tanto valorar directamente los mecanismos causales implicados en el desarrollo. La eficacia del ajuste de fase es la variable dependiente, el juego lingüístico es la intervención educativa y un cambio en la variable dependiente tras la intervención sugeriría la existencia de una relación positiva entre el juego lingüístico y la eficacia del sustrato fisiológico para la codificación lingüística. Como suele ocurrir en los estudios de desarrollo, habría que eliminar terceras variables posibles y sería importante probar los efectos de la intervención en diferentes ámbitos y poblaciones. La cuestión conceptual aquí es que una variable dependiente neural, como es la eficacia en el ajuste de fase, puede ser utilizada para comparar diferentes formas de intervención educativa temprana que pretendan potenciar el lenguaje de los niños y el desarrollo de la alfabetización e igualmente puede decirnos qué intervenciones presentan resultados tangibles sobre el sistema neural del niño para el lenguaje (en lugar de, por ejemplo, sobre la confianza o la auto-estima del niño –que también sería importante desde el punto de vista educativo, pero que implicaría mecanismos de desarrollo diferentes).

Además, dichos estudios neurocientíficos podrían constituir una razón para proporcionar experiencias educativas rítmicas y musicales extra a los niños que pueden correr el riesgo de padecer dificultades lectoras y por lo tanto para probar si realmente actúan afectando al sistema lingüístico en desarrollo. Dado que el cerebro es un sistema muy complejo e integrado, es posible que durante el desarrollo las experiencias tempranas que suplementan los ritmos auditivos con (pongamos por caso) ritmos motores (como por ejemplo al marchar al ritmo de la música) pueden o bien fortalecer los diferentes mecanismos de codificación que serán la base del ajuste rítmico auditivo (p. ej., mediante estructuras subcorticales como el cerebelo) o bien ejercer un efecto directo sobre la eficacia de los mecanismos oscilatorios la misma corteza auditiva (p. ej., mediante la integración multisensorial). Para la educación, lo que realmente importa es que éstas son cuestiones empíricas que pueden ser evaluadas y por lo tanto refutadas si son incorrectas. Son predicciones fisiológicas que están abiertas a verificación científica y falsación. Si marchar al ritmo de la música ajusta las oscilaciones theta, este debería ser el caso independientemente del contexto o situación de aprendizaje (aunque téngase en cuenta que un índice fisiológico del aprendizaje también nos permitiría averiguar si algunos contextos de aprendizaje son realmente más eficaces que otros para el acoplamiento –¡tales como aquellos que sean más divertidos!).

Téngase en cuenta igualmente que dichas medidas también nos proporcionarían una herramienta para poder probar los efectos de otras intervenciones educativas, por ejemplo intervenciones que se suponga remedien la dislexia del desarrollo. Un índice neural que se ha visto ligado al desarrollo fonológico, tal como (hipotéticamente) la eficacia del ajuste de fase en theta, podría emplearse para discriminar entre intervenciones educativas eficaces e ineficaces. Por ejemplo, cabría esperar que las intervenciones ineficaces también produzcan cambios en los procesos fisiológicos del cerebro, pero podría ser que sus efectos tuvieran lugar en sistemas neurales muy diferentes, quizá sistemas que no tengan ninguna relación con el lenguaje. Como los procesos fisiológicos son independientes de la atención y un proceso fisiológico como el ajuste de fase de las oscilaciones neuronales no puede (por lo que sabemos) realizarse conscientemente para algunos estímulos pero sí para otros, el estudio sistemático de aspectos muy básicos de la codificación de la información, tales como el ajuste de fase en diferentes sistemas neurales, tiene el potencial de proporcionar una base robusta para la educación.

Un resultado interesante de los estudios con biofeedback es que los humanos adultos pueden ajustarse selectivamente a frecuencias oscilatorias particulares en áreas concretas de la corteza para potenciar el aprendizaje motor. Rozengurt, Barnea y Reiner (2010) entrenaron a adultos a realizar una tarea de aprendizaje motor. A continuación usaron neurofeedback del EEG en un ambiente virtual para aumentar o bien su potencia en la banda theta (que se espera consolide la memoria, pues la actividad theta está relacionada con la consolidación en memoria durante el sueño) o bien la de la banda beta (una banda de frecuencia control). Un tercer grupo se tomó un descanso en lugar de realizar el biofeedback. Mientras el grupo theta mostró una mejora significativa en el aprendizaje motor tanto al cabo de un día, como de dos, como una semana más tarde, que no fue el caso para el grupo de biofeedback beta ni para el grupo de control. Aunque el aprendizaje de secuencias de dedos no es una tarea que se enseñe en la escuela, estos estudios demostrarían en principio que incrementar la potencia del EEG en determinadas frecuencias puede mejorar el aprendizaje humano. Por lo tanto, si las canciones infantiles aumentan la potencia de la banda theta en la corteza auditiva, este sería un dato de relevancia para los educadores. Quizá merezca la pena resaltar que la neurociencia cognitiva basada en tales principios podría suponer enormes beneficios educativos. Por ejemplo, en principio sería posible que surgieran nuevas intervenciones educativas formuladas con el objetivo de influir en determinadas frecuencias oscilatorias. Aquí he mostrado argumentos a favor de que algunas actividades tradicionalmente utilizadas en edades tempranas, tales como las canciones infantiles con juegos de rimas, la poesía, el canto y la música pueden afectar selectivamente a la actividad oscilatoria theta en la corteza auditiva. No obstante, es posible que se consigan efectos similares con otras intervenciones no consideradas aquí, por ejemplo intervenciones basadas en los neurotransmisores que afectan específicamente a esta actividad oscilatoria. Todas las intervenciones tempranas tendrían un impacto importante sobre las subsiguientes trayectorias de desarrollo para la alfabetización. Por lo tanto, desde mi punto de vista, si este marco conceptual es aceptado, los estudios básicos en neurociencia podrían tener un valor real para la educación.

ConclusiónEn esta discusión selectiva solo he pretendido ser muy ilustrativa, consciente de que mis propuestas son solo un posible marco de referencia para vincular la neurociencia cognitiva con la educación (véase también Goswami y Szucs, 2011; Nelson y Bloom, 1997). Espero haber podido mostrar el potencial que tiene la neurociencia cognitiva para realizar contribuciones útiles para la educación. Mi opinión es que para realizar una contribución duradera a la educación, la neurociencia educativa debe abordar en primer lugar cuestiones experimentales muy básicas. Necesitamos saber cómo se codifica y se transmite la información en el cerebro y cómo se relacionan con el aprendizaje estos procesos fisiológicos. Un buen punto de partida sería el procesamiento sensorial y el aprendizaje sensorial (como reconoció Piaget hace tiempo al poner el énfasis en el aprendizaje sensorio-motor; Piaget, 1954). No obstante, los estudios experimentales sobre estos procesos básicos deberían diseñarse considerando lo que ya sabemos sobre el desarrollo de los sistemas cognitivos relevantes para la educación a partir de la investigación en educación y en psicología. La investigación básica también debería tener en cuenta las teorías y los datos más recientes de la neurociencia en general. Las teorías neurocientíficas también deberían ser relevantes para el desarrollo, aunque los trabajos sobre el desarrollo sean más bien escasos dentro de la neurociencia (¡los bebés y los niños no suelen ser tan fáciles de tratar como los adultos o los animales!). En cualquier caso, la neurociencia como campo nos ofrece oportunidades únicas para poder estudiar y comprender los mecanismos causales del desarrollo. Necesitamos explorar los procesos de desarrollo que construyen las redes neurales aparentemente especializadas del cerebro de los adultos, con el fin de influir en las trayectorias de desarrollo y los estados finales de estas redes. A medida que mejoremos nuestra comprensión de los mecanismos causales del desarrollo a nivel sensorial en todo el cerebro, podremos estudiar cómo se relacionan entre sí esos mecanismos de aprendizaje y desarrollo para dar lugar a diferencias individuales en los logros educativos. Esto nos permitiría optimizar los ambientes educativos, tanto dentro como fuera de la escuela. También nos permitiría responder a algunas cuestiones sobre la naturaleza del conocimiento y sobre cómo aprendemos, así como sobre qué constituye un ser humano y su buen hacer, cuestiones que son del mayor interés para la educación.

Extended SummaryHere I set out one possible framework for linking basic research in neuroscience to pedagogical questions in education. I will endeavour to show via the illustrative example of reading/dyslexia research that neuroscience has the “authority” of making physiological discoveries that are open to empirical test and disconfirmation. I hope to show that the use of these “reductionist” methods has the potential to enrich considerably our understanding of children's learning and of how best to develop their potential.

Reading acquisition by children is predicted across languages by individual differences in children's awareness of the phonological (sound-based) structures of speech. This has been demonstrated in psychological and educational research by asking pre-reading and reading children to complete simple oral tasks such as counting the number of syllables in words or deciding whether words rhyme. “Suprasegmental” phonological awareness has also been shown to be important in explaining individual differences in reading. Suprasegmental awareness is awareness of the prosodic and stress patterns that characterise connected speech, when whole sentences or phrases rather than single words are the unit of phonological analysis. Indeed, as a lexicon of spoken word forms develops, both phonetic (“segmental”) and prosodic (“suprasegmental”) information is inextricably bound together in the phonological information stored by the brain for each word form. Across languages, the core perceptual unit reflecting these sound structures is now thought to be the syllable rather than the phoneme.

These different phonological and other skills are impaired in children who have developmental dyslexia. The best predictor across languages of who will have problems in acquiring the orthography of that language is phonological awareness. Children with dyslexia in languages as phonologically and orthographically diverse as English, Italian, and Chinese all have phonological difficulties.

The primary sense underlying speech perception is audition. Babies are hearing speech even while in the womb, although what they can hear best is the low frequency modulations in speech. Accordingly, babies seem born with some awareness of the characteristic rhythmic patterns of their native language. Once the baby is interacting with social partners, however, visual information from lip, jaw, and cheek cues supplements auditory information in important ways. These “speechreading” skills are important for efficiency in processing oral language. As we open and close our jaws to produce syllables, there is low frequency dynamic visual information centred at around 4Hz. In turn, the low frequency auditory information in speech yields syllabic structure, and peaks at around 4-6Hz. Hence, auditory and visual physiological mechanisms are converging to increase processing efficiency for language. Over the past decade, we have conducted a number of studies that suggest that the primary auditory difficulties for children with reading or language problems involve amplitude envelope processing. The amplitude envelope of speech refers to the fluctuations in sound intensity that reach the eardrums when listening to spoken language (see fig. 1). As speech is produced, energy (amplitude) rises and falls as syllables are produced and the jaws open and close. The ear then detects the different frequency bands in speech contained in the amplitude envelope and uses both amplitude (sound intensity) and frequency information to encode the signal. As a syllable is produced, energy will increase as the mouth opens, peaking at the production of the vowel. The rise time to the vowel, namely the onset of the amplitude envelope associated with a particular syllable, is a critical event in the speech signal, facilitating the temporal segmentation of the signal into syllables. Our data show that the difficulties in phonological processing found in both children with developmental dyslexia or specific language impairment (SLI) are strongly associated with inefficient basic auditory processing of rise time. Rise time perception in turn is crucial for developing the high-quality phonological representations of language required for the acquisition of literacy. Rise time discrimination is impaired in dyslexic children who speak English, French, Hungarian, Spanish, Chinese, and Finnish.

The brain processes speech over time, and it is a temporally complex signal. Many frequencies are varying at different time scales and at different intensities. According to the model by Hickok y Poeppel (2007), the cortex processes speech simultaneously on multiple time scales, particularly at two key temporal rates, a “suprasegmental” or syllabic rate (with a long temporal integration window of 150-300ms) and a “segmental” or “phonemic” (speech sound) rate, with a short temporal integration window of around 20-50ms. For humans and speech processing, it seems likely that neuroelectric oscillations in different frequency bands effectively segment the incoming speech signal into “packets” of information at different grain sizes. Via neural phase-locking (rhythmic entrainment) to incoming frequencies, the brain can track speech dynamics and discriminate spoken sentences, enabling speech to be understood. From EEG (electroencephalography), oscillatory frequencies in the human brain of interest here are Delta, 0.5-4Hz, Theta, 4-8Hz, and Gamma, 30-80Hz. During speech perception, studies with adults suggest that there is a “phase locking” at the Theta rate in Heschl's gyrus that determines the syllabic parsing of speech and its consequent intelligibility. Networks of neurons in this area of auditory cortex are thought to use events in the incoming signal such as rise times to reset their oscillatory activity, so that their natural oscillatory rate is in phase with the input, thereby enhancing sensory processing.

As both Theta and Gamma oscillatory rates appear to be intrinsic to human auditory cortex, phase resetting and phase locking phenomena could be studied in the first year of life and related to linguistic and phonological development. Such measures may also provide neural markers of risk for phonological disorders such as dyslexia, as may rise time sensitivity measured early in development. We can also explore whether the efficiency of phase locking in Heschl's gyrus predicts children's language and phonological development, and whether phase locking to the amplitude envelope of speech is impaired in dyslexia. Indeed, there is already some evidence supporting the latter prediction.

It would be extremely interesting to examine whether early pedagogical practices based on language play (rhyming games, syllable games) or on combining motor movements with language (clapping out syllable rhythms, marching in time to syllable beats), or singing to music (where the temporal structure of music must be co-ordinated with the temporal structure of language by aligning rhythmic structure) modulate the activity of the Theta oscillatory networks. By hypothesis, these educational activities should entrain the lower frequency oscillations in Heschl's gyrus (Theta and Delta), which appear to phase-lock to the syllable rate and to the intonational patterning of speech. The prediction is that the efficiency of phase locking (i.e., entrainment) of these Theta oscillators would be improved by children's language play. The conceptual point here is that a neural dependent variable, such as efficiency of phase locking, can be used to compare different forms of early educational intervention aimed at boosting children's language and literacy development, and can also tell us which interventions actually have their effects on the child's neural system for language. Further, such neuroscience studies could provide a rationale for giving children who may be at risk of reading difficulties extra rhythmic and musical educational experiences.

FinanciaciónUsha Goswami fue financiada por una Major Research Fellowship del Leverhulme Trust y una ayuda del Medical Research Council (G0902375).

Conflicto de interesesLa autora de este artículo declara que no tiene ningún conflicto de intereses.

El artículo original fue publicado en inglés por la British Psychological Society (BPS); Friederikson, N. y Laurillard, D. (Eds.) (2012). Educational Neuroscience. BJEP Monograph Series II, 8, 129-142. La BPS no se hace responsable de la exactitud de esta traducción.

La autora agradece a Victoria Leong la realización de la figura.